Veröffentlicht am 26. November 2025

HaptXDeep macht Roboter zu Lehrlingen

Am Institut für Fördertechnik und Logistiksysteme (IFL) des KIT entsteht derzeit ein System auf Basis künstlicher Intelligenz (KI), das die Lernweise von Robotern grundlegend verändern könnte. Das Projekt HaptXDeep, gefördert durch den Innovationscampus Mobilität der Zukunft (ICM), kombiniert feinfühlige Hardware mit lernfähiger Software und intuitiver Mensch-Maschine-Interaktion. „Unsere Vision ist, dass ein Roboter genauso schnell angelernt werden kann wie ein neuer menschlicher Mitarbeitender. Wird beispielsweise eine neue Person in einer Firma angelernt, dann benötigen Vorgesetzte oder Weisungsbefugte vielleicht ein paar Stunden, um einem Lehrling die neue Aufgabe zu zeigen. Und das soll im Prinzip auch für die Roboterimplementierung möglich sein“, erklärt Edgar Welte, Doktorand am IFL. Was heute meist noch Wochen bis Monate dauert, soll künftig mit HaptXDeep in wenigen Stunden ohne Robotik-Expertise möglich sein.

Per Handzeichen zur Manipulation

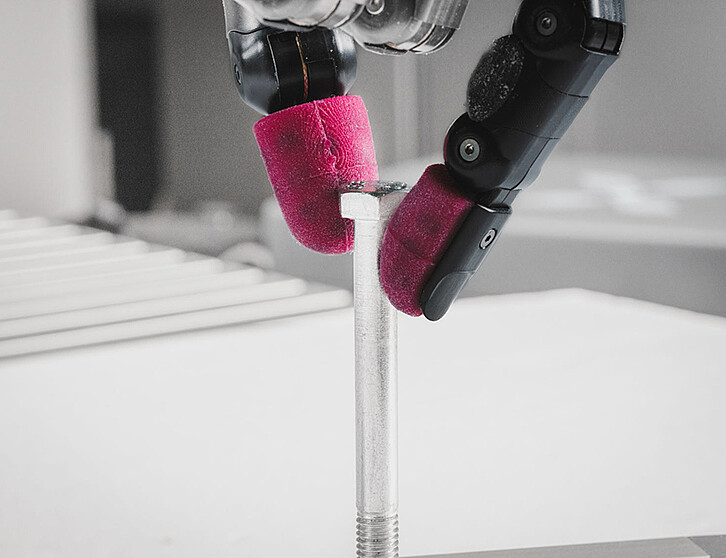

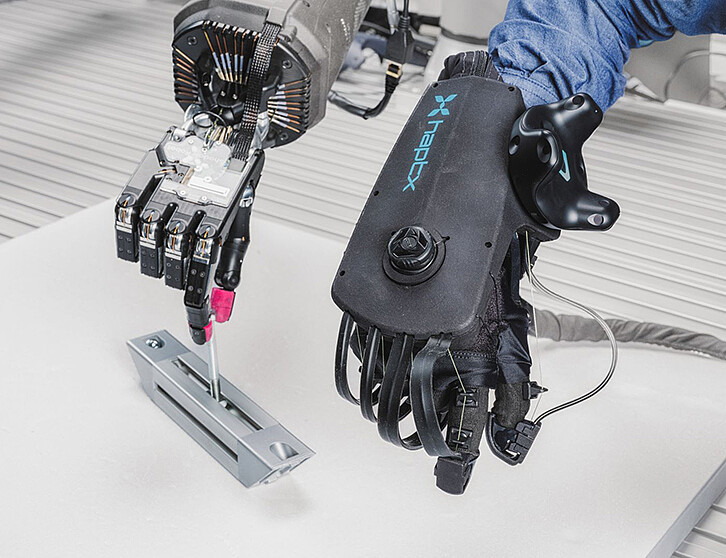

Im Rahmen des Projekts HaptXDeep wurde ein einzigartiges Robotersystem beschafft, um daran die KI zu erproben. Erstes Kernelement des Systems ist eine 5-fingrige Roboterhand von der Firma Shadow Robot mit zwanzig Freiheitsgraden, ermöglicht durch zwanzig individuell steuerbare Gelenke. Damit ist die künstliche Hand in der Lage, komplexe Greifbewegungen auszuführen, die der menschlichen Hand sehr nahekommen. Die Roboterhand ist montiert an einem sogenannten Cobot – ein kollaborativer Roboterarm, der ohne Schutzzaun mit Menschen zusammenarbeiten kann. Sie ist zudem mit hochsensitiven taktilen Sensoren ausgestattet, die präzise Kraft- und Berührungsinformationen erfassen. Gesteuert wird das System von Nutzenden über einen haptischen Handschuh der Firma HaptX, als zweites Kernelement, der nicht nur Bewegungen auf den Roboter überträgt, sondern dem Tragenden taktiles Feedback gibt. „Wenn ich mit dem Handschuh bzw. mit der Roboterhand als ‚verlängerten Arm‘ etwa eine Wasserflasche greife, spüre ich den Widerstand, den die Roboterfinger durch den Kontakt mit der Flasche spüren. Dazu befinden sich in den Fingerspitzen des Handschuhs je zwölf kleine Luftkammern, die sich bei Berührung der Roboterhand mit einem Objekt aufpumpen. Und wir nutzen diese gewonnenen Informationen, um unser KI-System zu trainieren, sodass der Roboter das durch die Objekte erzeugte taktile Feedback auswerten und daran angepasst adaptiv greifen kann“, erklärt Welte.

Lernen durch Vorführen

Der Lernprozess läuft in zwei technisch anspruchsvollen Phasen ab. Zunächst führt ein Domain-Experte – jemand, der sich mit der Aufgabe bestens auskennt – die Aufgabe einige Male vor und trägt dabei den teleoperativen Handschuh. Während dieser Vorführung bewegt sich die Roboterhand parallel mit und sammelt Daten über Bewegungen, Kräfte und Positionen. Welte verdeutlicht: „Anstatt den Menschen nur zu beobachten und davon zu lernen, schauen wir darauf, dass der Roboter selbst die Aufgabe ausführt. Der Mensch zeigt, der Roboter lernt – und beide arbeiten zusammen. Das Konzept des Nachahmens hat den Vorteil, dass der Roboter selbst wahrnimmt und über Sensoren ‚fühlt‘, wie er die Aufgabe auszuführen hat.“ Professorin Rania Rayyes, die die Synergien von künstlicher Intelligenz und Robotik zur interaktiven Robotermanipulation am IFL erforscht, ergänzt: „In unserer geplanten User Study wollen wir prüfen, ob diese Art der Teleoperation tatsächlich sehr intuitiv ist. Wir erwarten, dass Probanden ohne tieferes Expertenwissen keine großen Schwierigkeiten haben werden, den Roboter fernzusteuern. Hier betrachten wir auch, welche Güte die Vorführung der Aufgaben haben muss, dass sie immer noch zu guten Ergebnissen führt.“

In der zweiten Phase versucht der Roboter selbstständig, die Aufgabe auszuführen. Fehler sind dabei Teil des Konzepts. Der Roboter darf scheitern – und wird dann vom Menschen korrigiert. „Die anlernende Person steht nebenher und beobachtet die Teilschritte genau. Falls eine Ungenauigkeit oder ein Fehler passiert, korrigiert die Person kurz und lässt den Roboter weitermachen. Diese Korrekturen kann der Roboter nutzen, um weiter zu lernen“, beschreibt der Entwickler das intuitive Verfahren.

Wenn wenige Beispiele genügen

In Summe dauert dieser Prozess nur wenige Stunden. Die einfachen Teile der Aufgabe müssen nicht tausendmal wiederholt werden. Die interaktiven Korrekturen sind dafür umso wertvoller, weil sie genau dort ansetzen, wo die Aufgabe schwierig ist. „Die Bottlenecks in der Aufgabe kristallisieren sich automatisch heraus. Durch die Korrekturdurchläufe haben wir in den Schwierigkeitsregionen mehr Daten, im Restlichen haben wir weniger Daten. Dadurch ergibt sich ein sinnvolles Maß an Daten für den Lernprozess.“, so Welte. Es gibt immer eine gewisse Varianz in der Bewegung, mit der das System umgehen muss. Das Stichwort lautet Generalisierung: „Generalisierung beschreibt die Fähigkeit eines Modells, nicht nur die Trainingsdaten auswendig zu lernen, sondern auch auf neue, unbekannte Daten korrekt zu reagieren. Zum einen werden die vorgeführten Abläufe generalisiert, zum anderen der Roboter in seiner Ausführung. Die selbstlernenden Algorithmen, die wir entwickeln, ermöglichen es dem System, mit wenigen Demonstrationen zu generalisieren – auch wenn sich Form, Farbe oder Material des Objekts ändern.“

Warum Roboter neu denken müssen

Die Herausforderung liegt in der Vielfalt moderner Produktionsumgebungen. Während klassische Industrieroboter jahrzehntelang dieselben Aufgaben wiederholen, entstehen durch die Kreislaufwirtschaft völlig neue Anforderungen. Prof. Rayyes gibt Einblicke: „Häufig werden Roboter noch klassisch für eine spezifische, abgegrenzte Aufgabe programmiert. Gerade in der fortschreitenden Kreislaufwirtschaft, wo Bauteile unterschiedlich alt, beschädigt oder verändert sind, entstehen völlig neue Anforderungen durch Remanufacturing und Recycling. Hier müssen Roboter mit unterschiedlichen Produktgenerationen und -zuständen umgehen. Dafür gibt es am KIT das große Projekt ‚SFB1574 – Kreislauffabrik für das ewige Produkt‘, an dem wir beteiligt sind und in dem wir erforschen, wie sich Robotersysteme im Remanufacturing schnell an neue Aufgaben und Umgebungen anpassen können.“ Die Anwendungsmöglichkeiten sind dabei vielfältig: Montage, Demontage, Objektmanipulation – überall dort, wo Flexibilität und Feinmotorik gefragt sind. „Angesichts der aktuellen Herausforderungen der industriellen Kreislaufwirtschaft und des demografischen Wandels möchten wir eine intuitive Roboterprogrammierung durch menschliche Demonstrationen und Korrekturen umsetzen und zugleich adaptive Roboter durch fortschrittliche KI-Systeme ermöglichen, die sich mithilfe moderner Technologien wie HaptXDeep an dynamische Manipulationsaufgaben anpassen können“, schließt Prof. Rayyes.

Kommentare zu diesem Artikel

Keine Kommentare